Виды задач оптимизации. Задача оптимизации

Задача оптимизации Википедия

Оптимизация — в математике, информатике и исследовании операций задача нахождения экстремума (минимума или максимума) целевой функции в некоторой области конечномерного векторного пространства, ограниченной набором линейных и/или нелинейных равенств и/или неравенств.

Граф параболоида описанного функцией z = f(x, y) = −(x² + y²) + 4. Глобальный максимум от (x, y, z) = (0, 0, 4) обозначен синей точкой Поиск минимума Нелдера-Мида Функции оптимизации. Симплексные вершины упорядочиваются по их значению, при этом 1 имеет наименьшее (лучшее) значение.

Поиск минимума Нелдера-Мида Функции оптимизации. Симплексные вершины упорядочиваются по их значению, при этом 1 имеет наименьшее (лучшее) значение. Теорию и методы решения задачи оптимизации изучает математическое программирование.

Математическое программирование — это область математики, разрабатывающая теорию, численные методы решения многомерных задач с ограничениями. В отличие от классической математики, математическое программирование занимается математическими методами решения задач нахождения наилучших вариантов из всех возможных.[1]

Постановка задачи оптимизации[ | код]

В процессе проектирования ставится обычно задача определения наилучших, в некотором смысле, структуры или значений параметров объектов. Такая задача называется оптимизационной. Если оптимизация связана с расчётом оптимальных значений параметров при заданной структуре объекта, то она называется параметрической оптимизацией. Задача выбора оптимальной структуры является структурной оптимизацией.

Стандартная математическая задача оптимизации формулируется таким образом. Среди элементов χ, образующих множества Χ, найти такой элемент χ*, который доставляет минимальное значение f(χ*) заданной функции f(χ). Для того, чтобы корректно поставить задачу оптимизации, необходимо задать:

- Допустимое множество — множество X={x→|gi(x→)≤0,i=1,…,m}⊂Rn{\displaystyle \mathbb {X} =\{{\vec {x}}|\;g_{i}({\vec {x}})\leq 0,\;i=1,\ldots ,m\}\subset \mathbb {R} ^{n}};

- Целевую функцию — отображение f:X→R{\displaystyle f:\;\mathbb {X} \to \mathbb {R} };

- Критерий поиска (max или min).

Тогда решить задачу f(x)→minx→∈X{\displaystyle f(x)\to \min _{{\vec {x}}\in \mathrm {X} }} означает одно из:

- Показать, что X=∅{\displaystyle \mathbb {X} =\varnothing }.

- Показать, что

ru-wiki.ru

Задача оптимизации - Википедия

Материал из Википедии — свободной энциклопедии

У этого термина существуют и другие значения, см. Оптимизация.Оптимизация — в математике, информатике и исследовании операций задача нахождения экстремума (минимума или максимума) целевой функции в некоторой области конечномерного векторного пространства, ограниченной набором линейных и/или нелинейных равенств и/или неравенств.

Теорию и методы решения задачи оптимизации изучает математическое программирование.

Математическое программирование — это область математики, разрабатывающая теорию, численные методы решения многомерных задач с ограничениями. В отличие от классической математики, математическое программирование занимается математическими методами решения задач нахождения наилучших вариантов из всех возможных.[1]

Постановка задачи оптимизации[ | ]

В процессе проектирования ставится обычно задача определения наилучших, в некотором смысле, структуры или значений параметров объектов. Такая задача называется оптимизационной. Если оптимизация связана с расчётом оптимальных значений параметров при заданной структуре объекта, то она называется параметрической оптимизацией. Задача выбора оптимальной структуры является структурной оптимизацией.

Стандартная математическая задача оптимизации формулируется таким образом. Среди элементов χ, образующих множества Χ, найти такой элемент χ*, который доставляет минимальное значение f(χ*) заданной функции f(χ). Для того, чтобы корректно поставить задачу оптимизации, необходимо задать:

- Допустимое множество — множество X={x→|gi(x→)≤0,i=1,…,m}⊂Rn{\displaystyle \mathbb {X} =\{{\vec {x}}|\;g_{i}({\vec {x}})\leq 0,\;i=1,\ldots ,m\}\subset \mathbb {R} ^{n}};

- Целевую функцию — отображение f:X→R{\displaystyle f:\;\mathbb {X} \to \mathbb {R} };

- Критерий поиска (max или min).

Тогда решить задачу f(x)→minx→∈X{\displaystyle f(x)\to \min _{{\vec {x}}\in \mathrm {X} }} означает одно из:

- Показать, что X=∅{\displaystyle \mathbb {X} =\varnothing }.

- Показать, что целевая функция f(x→){\displaystyle f({\vec {x}})} не ограничена снизу.

- Найти x→∗∈X:f(x→∗)=minx→∈Xf(x→){\displaystyle {\vec {x}}^{*}\in \mathbb {X} :\;f({\vec {x}}^{*})=\min _{{\vec {x}}\in \mathbb {X} }f({\vec {x}})}

encyclopaedia.bid

Виды задач оптимизации - Документ

Виды задач оптимизации.

В общем случае задача оптимизации может быть записана следующим образом:

Система (1) представляет собой общий случай математической постановки задачи оптимизации. Она включает целевую функцию Е = f (xj); ограничения gi(xj) <= bi; граничные условия di<= xj<= Dj. Суть такой постановки задачи заключается в следующем: необходимо определить такие значения xj , которые, находясь в граничных условиях dj<= xj<= Dj , удовлетворяли бы ограничениям gi(xj) <= bi и при этом придавали бы целевой функции Е = f (xj) искомое оптимальное значение.

Функция f (x) имеет максимум в точке x = a, если, в достаточной близости от этой точки всем значениям x(как большим, так и меньшим a) соответствуют значения f (x) меньшие, чем f (a). Функция f (x) имеет минимум в точке x = a, если в достаточной близости от этой точки всем значениям x соответствуют значения f (x) большие, чем f (a).

Максимум и минимум объединяются понятием “экстремум”. (Латинское слово “экстремум” означает “крайнее”). Экстремум не может быть на границе рассматриваемого интервала. В задачах оптимизации нас интересует наибольшее (наименьшее) значение целевой функции, включая значения целевой функции на границах dj<= xj<= Dj. Наибольшее (наименьшее) значение целевой функции, включая ее значения на границах интервала [djDj], называют оптимальным значением или оптимумом.

Если при нахождении экстремума накладываются дополнительные условия – ограничения на зависимости между переменными – то экстремум называется условным. Поскольку оптимум, как правило, определяется при наложении ряда дополнительных условий – ограничений, термин “условный оптимум” обычно не применяется. Задача (1) представляет собой задачу нахождения оптимума.

В каждом конкретном случае система (1) определяется видом переменных xj и зависимостей f (xj) и gi(xj). Различные виды переменных и зависимостей между ними требуют различных методов решения задачи оптимизации. В зависимости от классов математических описаний задач элементы системы (1) могут быть различными (рис.1).

Зависимости между переменными в (1) входят в

ограничения и целевую функцию. По виду действия над переменными зависимости могут быть алгебраическими и дифференциальными. Задачи, содержащие дифференциальные зависимости в функции времени, называются задачами оптимального управления или реже – динамической оптимизации.

Линейными называются такие зависимости, в которых переменные или производные находятся в первой степени. Если в зависимостях имеются переменные в степени, отличной от первой, или произведения двух и более переменных, то такие зависимости называются нелинейными.

Задачи оптимизации, содержащие линейные алгебраические зависимости в целевой функции и ограничениях, являются задачами ЛП. Для задачи ЛП система (1) будет иметь вид (2):

Если в задаче оптимизации хотя бы одно ограничение или только целевая функция представляет собой нелинейную зависимость, задача является задачей нелинейного программирования (НЛП).

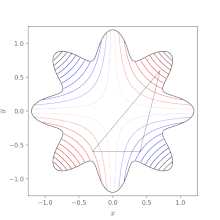

На рис. 2 дана графически задача НЛП на плоскости. Из рисунка видно, что даже в том случае, когда только одно ограничение будет нелинейным (рис. 2, а), оптимальным решением задачи оптимизации будут координаты не вершины, а какой-то произвольной точки. Аналогичное положение будет и в том случае, когда все ограничения линейны, а нелинейна только целевая функция (рис. 2, б). Такое положение существенно усложняет решение задач НЛП, так как метод перебора вершин, применяемый для задач ЛП, в данном случае оказывается непригодным.

Переменные можно подразделить на непрерывные и дискретные, детерминированные и случайные. Если величины в заданном интервале граничных условий могут принимать любые промежуточные значения, они называются непрерывными. Примером непрерывных переменных может служить производительность, масса, стоимость и т.д. Если переменные в заданном интервале могут принимать лишь определенные значения, они называются дискретными.

Дискретные переменные, в свою очередь могут быть целочисленными, заданными и булевыми. Целочисленными переменными называются также переменные, которые могут принимать только целые значения. В ряде случаев переменные могут принимать лишь определенные заданные значения. Например, диаметр трубы не может быть произвольным, он должен соответствовать ГОСТу и быть равным одному из заданных размеров: 100, 150, 200, 250 мм и т.д.

Важным видом дискретных переменных являются булевые переменные. Булевые переменные могут принимать только два значения: 0 или 1. Если принимать, что 1 соответствует «да», а 0 – «нет», то с помощью булевых переменных можно решать логические, комбинационные и ряд других специфических задач.

Задачи оптимизации, в которых переменные могут быть только дискретными, называются задачами дискретного или чаще целочисленного программирования (ЦП). Если в задаче часть переменных должна быть целочисленной, а остальные могут принимать непрерывные значения, то такая задача является задачей частично-целочисленного программирования (ЧЦП).

Решение задач ЦП на плоскости приведено на рис. 3. Оптимальное решение в данном случае будет не в вершине ОДР (в точке А), а в узле сетки, имеющем целые значения переменных. При этом в случае, например, максимизации целевой функции её целочисленное значение будет меньше непрерывного. Следовательно, требование целочисленности, как и любое дополнительное требование, ухудшает значение целевой функции.

Результат решения задачи оптимизации, т.е. значения величин в оптимальном решении, является функцией заданных величин, входящих в модель, например, для задач ЛП функцией cj, aij, bi. Если эти величины являются детерминированными, то и величины xj, как функции детерминированных величин, будут также детерминированными. Если же хотя бы одна из заданных величин будет случайной, то величины xj, как функции случайных величин, будут также случайными величинами.

Задачи оптимизации, в которые входят случайные величины, называются задачами стохастического программирования (СТП).

Все рассмотренные классы задач относятся к задачам математического программирования.

textarchive.ru

Задача оптимизации - это... Что такое Задача оптимизации?

Задача оптимизацииЗадачей оптимизации в математике называется задача о нахождении экстремума (минимума или максимума) вещественной функции в некоторой области. Как правило, рассматриваются области, принадлежащие и заданные набором равенств и неравенств.

Постановка задачи оптимизации

Для того, чтобы корректно поставить задачу оптимизации необходимо задать:

- Допустимое множество — множество ;

- Целевую функцию — отображение ;

- Критерий поиска (max или min).

Тогда решить задачу означает одно из:

- Показать, что .

- Показать, что целевая функция не ограничена.

- Найти .

- Если , то найти .

Если минимизируемая функция не является выпуклой, то часто ограничиваются поиском локальных минимумов и максимумов: точек x0 таких, что всюду в некоторой их окрестности для минимума и для максимума.

Если допустимое множество , то такая задача называется задачей безусловной оптимизации, в противном случае — задачей условной оптимизации.

Классификация методов оптимизации

Методы, по средством которых решают задачи оптимизации, подразделяются на виды, соответствующие задачам, к которым они применяются:

- Локальные методы (задача оптимизации унимодальной целевой функции).

- Глобальные методы (имеют дело с многоэкстремальными целевыми функциями. При глобальном поиске основной задачей является выявление тенденций глобального поведения целевой функции.).

Существующие в настоящее время методы поиска можно разбить на три большие группы:

- детерминированные;

- случайные;

- комбинированные.

Некоторые детерминированные методы:

- Задачи оптимизации, в которых целевая функция и ограничения являются линейными функциями, разрешаются так называемыми методами линейного программирования.

- В противном случае имеют дело с задачей нелинейного программирования и применяют соответствующие методы. В свою очередь из них выделяют две частные задачи:

Помимо того, оптимизационные методы делятся на следующие группы:

Также они разделяются по критерию размерности допустимого множества на методы одномерной оптимизации и методы многомерной оптимизации.

Литература

- Акулич И.Л. Математическое программирование в примерах и задачах: Учеб. пособие для студентов эконом. пец. вузов. — М.: Высшая школа, 1986.

- Гилл Ф., Мюррей У., Райт М. Практическая оптимизация. Пер. с англ. — М.: Мир, 1985.

- Коршунов Ю.М., Коршунов Ю.М. Математические основы кибернетики. — М.: Энергоатомиздат, 1972.

- Максимов Ю.А.,Филлиповская Е.А. Алгоритмы решения задач нелинейного программирования. — М.: МИФИ, 1982.

- Максимов Ю.А. Алгоритмы линейного и дискретного программирования. — М.: МИФИ, 1980.

- Корн Г., Корн Т. Справочник по математике для научных работников и инженеров. — М.: Наука, 1970. — С. 575-576.

- Жиглявский А.А., Жилинкас А.Г. Методы поиска глобального экстремума. — М.: Наука, Физматлит, 1991.

- Растригин Л.А. Статистические методы поиска. — М.: 1968.

- Абакаров А.Ш., Сушков Ю.А. Статистическое исследование одного алгоритма глобальной оптимизации. — Труды ФОРА, 2004.

Ссылки

- MDOP — Поиск глобального оптимума для задач оптимального проектирования систем или определения оптимальных законов управления.

- Глобальная оптимизация, принятие решений — Программные системы поддержки принятия оптимальных решений. Глобальные алгоримы.

Wikimedia Foundation. 2010.

- Задача о четырёх красках

- Задача трех тел

Смотреть что такое "Задача оптимизации" в других словарях:

задача оптимизации надёжности — — [http://slovarionline.ru/anglo russkiy slovar neftegazovoy promyishlennosti/] Тематики нефтегазовая промышленность EN reliability optimization problem … Справочник технического переводчика

Задача о порядке перемножения матриц — Задача о порядке перемножения матриц классическая задача динамического программирования, в которой дана последовательность матриц и требуется минимизировать количество скалярных операций для вычисления их произведения. Матрицы… … Википедия

Задача о рюкзаке — Задача о ранце (рюкзаке) одна из задач комбинаторной оптимизации. Название это получила от максимизационной задачи укладки как можно большего числа нужных вещей в рюкзак при условии, что общий объём (или вес) всех предметов ограничен. Подобные… … Википедия

Задача о рюказаке — Задача о ранце (рюкзаке) одна из задач комбинаторной оптимизации. Название это получила от максимизационной задачи укладки как можно большего числа нужных вещей в рюкзак при условии, что общий объём (или вес) всех предметов ограничен. Подобные… … Википедия

Задача о коммивояжере — Задача коммивояжёра (коммивояжёр бродячий торговец) является одной из самых известных задач комбинаторной оптимизации. Задача заключается в отыскании самого выгодного маршрута, проходящего через указанные города хотя бы по одному разу с… … Википедия

Задача о коммивояжёре — Задача коммивояжёра (коммивояжёр бродячий торговец) является одной из самых известных задач комбинаторной оптимизации. Задача заключается в отыскании самого выгодного маршрута, проходящего через указанные города хотя бы по одному разу с… … Википедия

Задача коммивояжера — Задача коммивояжёра (коммивояжёр бродячий торговец) является одной из самых известных задач комбинаторной оптимизации. Задача заключается в отыскании самого выгодного маршрута, проходящего через указанные города хотя бы по одному разу с… … Википедия

Задача коммивояжёра — Оптимальный маршрут коммивояжёра через 15 крупнейших городов Германии. Указанный маршрут является самым коротким из всех возможных 43 589 145 600. Задача коммивояжёра (англ. Travelling salesman problem, TSP) (коммивояжёр … Википедия

Задача о ранце — Пример задачи о ранце: необходимо разместить ящики в рюкзак при условии на вместимость рюкзака 15 кг, так чтобы суммарная полезность предметов в рюкзаке была максимальной. Задача о ранце (рюкзаке) (англ. … Википедия

Задача о максимальном потоке — Максимальный поток в транспортной сети. Числа обозначают потоки и пропускные способности. В теории оптимизации и теории графов, задача о максимальном потоке заключается в нахождении такого потока по транспортной сети, что сум … Википедия

dikc.academic.ru

Задача оптимизации - это... Что такое Задача оптимизации?

Задача оптимизацииЗадачей оптимизации в математике называется задача о нахождении экстремума (минимума или максимума) вещественной функции в некоторой области. Как правило, рассматриваются области, принадлежащие и заданные набором равенств и неравенств.

Постановка задачи оптимизации

Для того, чтобы корректно поставить задачу оптимизации необходимо задать:

- Допустимое множество — множество ;

- Целевую функцию — отображение ;

- Критерий поиска (max или min).

Тогда решить задачу означает одно из:

- Показать, что .

- Показать, что целевая функция не ограничена.

- Найти .

- Если , то найти .

Если минимизируемая функция не является выпуклой, то часто ограничиваются поиском локальных минимумов и максимумов: точек x0 таких, что всюду в некоторой их окрестности для минимума и для максимума.

Если допустимое множество , то такая задача называется задачей безусловной оптимизации, в противном случае — задачей условной оптимизации.

Классификация методов оптимизации

Методы, по средством которых решают задачи оптимизации, подразделяются на виды, соответствующие задачам, к которым они применяются:

- Локальные методы (задача оптимизации унимодальной целевой функции).

- Глобальные методы (имеют дело с многоэкстремальными целевыми функциями. При глобальном поиске основной задачей является выявление тенденций глобального поведения целевой функции.).

Существующие в настоящее время методы поиска можно разбить на три большие группы:

- детерминированные;

- случайные;

- комбинированные.

Некоторые детерминированные методы:

- Задачи оптимизации, в которых целевая функция и ограничения являются линейными функциями, разрешаются так называемыми методами линейного программирования.

- В противном случае имеют дело с задачей нелинейного программирования и применяют соответствующие методы. В свою очередь из них выделяют две частные задачи:

Помимо того, оптимизационные методы делятся на следующие группы:

Также они разделяются по критерию размерности допустимого множества на методы одномерной оптимизации и методы многомерной оптимизации.

Литература

- Акулич И.Л. Математическое программирование в примерах и задачах: Учеб. пособие для студентов эконом. пец. вузов. — М.: Высшая школа, 1986.

- Гилл Ф., Мюррей У., Райт М. Практическая оптимизация. Пер. с англ. — М.: Мир, 1985.

- Коршунов Ю.М., Коршунов Ю.М. Математические основы кибернетики. — М.: Энергоатомиздат, 1972.

- Максимов Ю.А.,Филлиповская Е.А. Алгоритмы решения задач нелинейного программирования. — М.: МИФИ, 1982.

- Максимов Ю.А. Алгоритмы линейного и дискретного программирования. — М.: МИФИ, 1980.

- Корн Г., Корн Т. Справочник по математике для научных работников и инженеров. — М.: Наука, 1970. — С. 575-576.

- Жиглявский А.А., Жилинкас А.Г. Методы поиска глобального экстремума. — М.: Наука, Физматлит, 1991.

- Растригин Л.А. Статистические методы поиска. — М.: 1968.

- Абакаров А.Ш., Сушков Ю.А. Статистическое исследование одного алгоритма глобальной оптимизации. — Труды ФОРА, 2004.

Ссылки

- MDOP — Поиск глобального оптимума для задач оптимального проектирования систем или определения оптимальных законов управления.

- Глобальная оптимизация, принятие решений — Программные системы поддержки принятия оптимальных решений. Глобальные алгоримы.

Wikimedia Foundation. 2010.

- Задача о четырёх красках

- Задача трех тел

Смотреть что такое "Задача оптимизации" в других словарях:

задача оптимизации надёжности — — [http://slovarionline.ru/anglo russkiy slovar neftegazovoy promyishlennosti/] Тематики нефтегазовая промышленность EN reliability optimization problem … Справочник технического переводчика

Задача о порядке перемножения матриц — Задача о порядке перемножения матриц классическая задача динамического программирования, в которой дана последовательность матриц и требуется минимизировать количество скалярных операций для вычисления их произведения. Матрицы… … Википедия

Задача о рюкзаке — Задача о ранце (рюкзаке) одна из задач комбинаторной оптимизации. Название это получила от максимизационной задачи укладки как можно большего числа нужных вещей в рюкзак при условии, что общий объём (или вес) всех предметов ограничен. Подобные… … Википедия

Задача о рюказаке — Задача о ранце (рюкзаке) одна из задач комбинаторной оптимизации. Название это получила от максимизационной задачи укладки как можно большего числа нужных вещей в рюкзак при условии, что общий объём (или вес) всех предметов ограничен. Подобные… … Википедия

Задача о коммивояжере — Задача коммивояжёра (коммивояжёр бродячий торговец) является одной из самых известных задач комбинаторной оптимизации. Задача заключается в отыскании самого выгодного маршрута, проходящего через указанные города хотя бы по одному разу с… … Википедия

Задача о коммивояжёре — Задача коммивояжёра (коммивояжёр бродячий торговец) является одной из самых известных задач комбинаторной оптимизации. Задача заключается в отыскании самого выгодного маршрута, проходящего через указанные города хотя бы по одному разу с… … Википедия

Задача коммивояжера — Задача коммивояжёра (коммивояжёр бродячий торговец) является одной из самых известных задач комбинаторной оптимизации. Задача заключается в отыскании самого выгодного маршрута, проходящего через указанные города хотя бы по одному разу с… … Википедия

Задача коммивояжёра — Оптимальный маршрут коммивояжёра через 15 крупнейших городов Германии. Указанный маршрут является самым коротким из всех возможных 43 589 145 600. Задача коммивояжёра (англ. Travelling salesman problem, TSP) (коммивояжёр … Википедия

Задача о ранце — Пример задачи о ранце: необходимо разместить ящики в рюкзак при условии на вместимость рюкзака 15 кг, так чтобы суммарная полезность предметов в рюкзаке была максимальной. Задача о ранце (рюкзаке) (англ. … Википедия

Задача о максимальном потоке — Максимальный поток в транспортной сети. Числа обозначают потоки и пропускные способности. В теории оптимизации и теории графов, задача о максимальном потоке заключается в нахождении такого потока по транспортной сети, что сум … Википедия

med.academic.ru

Задача оптимизации - это... Что такое Задача оптимизации?

Задача оптимизацииЗадачей оптимизации в математике называется задача о нахождении экстремума (минимума или максимума) вещественной функции в некоторой области. Как правило, рассматриваются области, принадлежащие и заданные набором равенств и неравенств.

Постановка задачи оптимизации

Для того, чтобы корректно поставить задачу оптимизации необходимо задать:

- Допустимое множество — множество ;

- Целевую функцию — отображение ;

- Критерий поиска (max или min).

Тогда решить задачу означает одно из:

- Показать, что .

- Показать, что целевая функция не ограничена.

- Найти .

- Если , то найти .

Если минимизируемая функция не является выпуклой, то часто ограничиваются поиском локальных минимумов и максимумов: точек x0 таких, что всюду в некоторой их окрестности для минимума и для максимума.

Если допустимое множество , то такая задача называется задачей безусловной оптимизации, в противном случае — задачей условной оптимизации.

Классификация методов оптимизации

Методы, по средством которых решают задачи оптимизации, подразделяются на виды, соответствующие задачам, к которым они применяются:

- Локальные методы (задача оптимизации унимодальной целевой функции).

- Глобальные методы (имеют дело с многоэкстремальными целевыми функциями. При глобальном поиске основной задачей является выявление тенденций глобального поведения целевой функции.).

Существующие в настоящее время методы поиска можно разбить на три большие группы:

- детерминированные;

- случайные;

- комбинированные.

Некоторые детерминированные методы:

- Задачи оптимизации, в которых целевая функция и ограничения являются линейными функциями, разрешаются так называемыми методами линейного программирования.

- В противном случае имеют дело с задачей нелинейного программирования и применяют соответствующие методы. В свою очередь из них выделяют две частные задачи:

Помимо того, оптимизационные методы делятся на следующие группы:

Также они разделяются по критерию размерности допустимого множества на методы одномерной оптимизации и методы многомерной оптимизации.

Литература

- Акулич И.Л. Математическое программирование в примерах и задачах: Учеб. пособие для студентов эконом. пец. вузов. — М.: Высшая школа, 1986.

- Гилл Ф., Мюррей У., Райт М. Практическая оптимизация. Пер. с англ. — М.: Мир, 1985.

- Коршунов Ю.М., Коршунов Ю.М. Математические основы кибернетики. — М.: Энергоатомиздат, 1972.

- Максимов Ю.А.,Филлиповская Е.А. Алгоритмы решения задач нелинейного программирования. — М.: МИФИ, 1982.

- Максимов Ю.А. Алгоритмы линейного и дискретного программирования. — М.: МИФИ, 1980.

- Корн Г., Корн Т. Справочник по математике для научных работников и инженеров. — М.: Наука, 1970. — С. 575-576.

- Жиглявский А.А., Жилинкас А.Г. Методы поиска глобального экстремума. — М.: Наука, Физматлит, 1991.

- Растригин Л.А. Статистические методы поиска. — М.: 1968.

- Абакаров А.Ш., Сушков Ю.А. Статистическое исследование одного алгоритма глобальной оптимизации. — Труды ФОРА, 2004.

Ссылки

- MDOP — Поиск глобального оптимума для задач оптимального проектирования систем или определения оптимальных законов управления.

- Глобальная оптимизация, принятие решений — Программные системы поддержки принятия оптимальных решений. Глобальные алгоримы.

Wikimedia Foundation. 2010.

- Задача о четырёх красках

- Задача трех тел

Смотреть что такое "Задача оптимизации" в других словарях:

задача оптимизации надёжности — — [http://slovarionline.ru/anglo russkiy slovar neftegazovoy promyishlennosti/] Тематики нефтегазовая промышленность EN reliability optimization problem … Справочник технического переводчика

Задача о порядке перемножения матриц — Задача о порядке перемножения матриц классическая задача динамического программирования, в которой дана последовательность матриц и требуется минимизировать количество скалярных операций для вычисления их произведения. Матрицы… … Википедия

Задача о рюкзаке — Задача о ранце (рюкзаке) одна из задач комбинаторной оптимизации. Название это получила от максимизационной задачи укладки как можно большего числа нужных вещей в рюкзак при условии, что общий объём (или вес) всех предметов ограничен. Подобные… … Википедия

Задача о рюказаке — Задача о ранце (рюкзаке) одна из задач комбинаторной оптимизации. Название это получила от максимизационной задачи укладки как можно большего числа нужных вещей в рюкзак при условии, что общий объём (или вес) всех предметов ограничен. Подобные… … Википедия

Задача о коммивояжере — Задача коммивояжёра (коммивояжёр бродячий торговец) является одной из самых известных задач комбинаторной оптимизации. Задача заключается в отыскании самого выгодного маршрута, проходящего через указанные города хотя бы по одному разу с… … Википедия

Задача о коммивояжёре — Задача коммивояжёра (коммивояжёр бродячий торговец) является одной из самых известных задач комбинаторной оптимизации. Задача заключается в отыскании самого выгодного маршрута, проходящего через указанные города хотя бы по одному разу с… … Википедия

Задача коммивояжера — Задача коммивояжёра (коммивояжёр бродячий торговец) является одной из самых известных задач комбинаторной оптимизации. Задача заключается в отыскании самого выгодного маршрута, проходящего через указанные города хотя бы по одному разу с… … Википедия

Задача коммивояжёра — Оптимальный маршрут коммивояжёра через 15 крупнейших городов Германии. Указанный маршрут является самым коротким из всех возможных 43 589 145 600. Задача коммивояжёра (англ. Travelling salesman problem, TSP) (коммивояжёр … Википедия

Задача о ранце — Пример задачи о ранце: необходимо разместить ящики в рюкзак при условии на вместимость рюкзака 15 кг, так чтобы суммарная полезность предметов в рюкзаке была максимальной. Задача о ранце (рюкзаке) (англ. … Википедия

Задача о максимальном потоке — Максимальный поток в транспортной сети. Числа обозначают потоки и пропускные способности. В теории оптимизации и теории графов, задача о максимальном потоке заключается в нахождении такого потока по транспортной сети, что сум … Википедия

muller.academic.ru

Задача оптимизации - это... Что такое Задача оптимизации?

Задача оптимизацииЗадачей оптимизации в математике называется задача о нахождении экстремума (минимума или максимума) вещественной функции в некоторой области. Как правило, рассматриваются области, принадлежащие и заданные набором равенств и неравенств.

Постановка задачи оптимизации

Для того, чтобы корректно поставить задачу оптимизации необходимо задать:

- Допустимое множество — множество ;

- Целевую функцию — отображение ;

- Критерий поиска (max или min).

Тогда решить задачу означает одно из:

- Показать, что .

- Показать, что целевая функция не ограничена.

- Найти .

- Если , то найти .

Если минимизируемая функция не является выпуклой, то часто ограничиваются поиском локальных минимумов и максимумов: точек x0 таких, что всюду в некоторой их окрестности для минимума и для максимума.

Если допустимое множество , то такая задача называется задачей безусловной оптимизации, в противном случае — задачей условной оптимизации.

Классификация методов оптимизации

Методы, по средством которых решают задачи оптимизации, подразделяются на виды, соответствующие задачам, к которым они применяются:

- Локальные методы (задача оптимизации унимодальной целевой функции).

- Глобальные методы (имеют дело с многоэкстремальными целевыми функциями. При глобальном поиске основной задачей является выявление тенденций глобального поведения целевой функции.).

Существующие в настоящее время методы поиска можно разбить на три большие группы:

- детерминированные;

- случайные;

- комбинированные.

Некоторые детерминированные методы:

- Задачи оптимизации, в которых целевая функция и ограничения являются линейными функциями, разрешаются так называемыми методами линейного программирования.

- В противном случае имеют дело с задачей нелинейного программирования и применяют соответствующие методы. В свою очередь из них выделяют две частные задачи:

Помимо того, оптимизационные методы делятся на следующие группы:

Также они разделяются по критерию размерности допустимого множества на методы одномерной оптимизации и методы многомерной оптимизации.

Литература

- Акулич И.Л. Математическое программирование в примерах и задачах: Учеб. пособие для студентов эконом. пец. вузов. — М.: Высшая школа, 1986.

- Гилл Ф., Мюррей У., Райт М. Практическая оптимизация. Пер. с англ. — М.: Мир, 1985.

- Коршунов Ю.М., Коршунов Ю.М. Математические основы кибернетики. — М.: Энергоатомиздат, 1972.

- Максимов Ю.А.,Филлиповская Е.А. Алгоритмы решения задач нелинейного программирования. — М.: МИФИ, 1982.

- Максимов Ю.А. Алгоритмы линейного и дискретного программирования. — М.: МИФИ, 1980.

- Корн Г., Корн Т. Справочник по математике для научных работников и инженеров. — М.: Наука, 1970. — С. 575-576.

- Жиглявский А.А., Жилинкас А.Г. Методы поиска глобального экстремума. — М.: Наука, Физматлит, 1991.

- Растригин Л.А. Статистические методы поиска. — М.: 1968.

- Абакаров А.Ш., Сушков Ю.А. Статистическое исследование одного алгоритма глобальной оптимизации. — Труды ФОРА, 2004.

Ссылки

- MDOP — Поиск глобального оптимума для задач оптимального проектирования систем или определения оптимальных законов управления.

- Глобальная оптимизация, принятие решений — Программные системы поддержки принятия оптимальных решений. Глобальные алгоримы.

Wikimedia Foundation. 2010.

- Задача о четырёх красках

- Задача трех тел

Смотреть что такое "Задача оптимизации" в других словарях:

задача оптимизации надёжности — — [http://slovarionline.ru/anglo russkiy slovar neftegazovoy promyishlennosti/] Тематики нефтегазовая промышленность EN reliability optimization problem … Справочник технического переводчика

Задача о порядке перемножения матриц — Задача о порядке перемножения матриц классическая задача динамического программирования, в которой дана последовательность матриц и требуется минимизировать количество скалярных операций для вычисления их произведения. Матрицы… … Википедия

Задача о рюкзаке — Задача о ранце (рюкзаке) одна из задач комбинаторной оптимизации. Название это получила от максимизационной задачи укладки как можно большего числа нужных вещей в рюкзак при условии, что общий объём (или вес) всех предметов ограничен. Подобные… … Википедия

Задача о рюказаке — Задача о ранце (рюкзаке) одна из задач комбинаторной оптимизации. Название это получила от максимизационной задачи укладки как можно большего числа нужных вещей в рюкзак при условии, что общий объём (или вес) всех предметов ограничен. Подобные… … Википедия

Задача о коммивояжере — Задача коммивояжёра (коммивояжёр бродячий торговец) является одной из самых известных задач комбинаторной оптимизации. Задача заключается в отыскании самого выгодного маршрута, проходящего через указанные города хотя бы по одному разу с… … Википедия

Задача о коммивояжёре — Задача коммивояжёра (коммивояжёр бродячий торговец) является одной из самых известных задач комбинаторной оптимизации. Задача заключается в отыскании самого выгодного маршрута, проходящего через указанные города хотя бы по одному разу с… … Википедия

Задача коммивояжера — Задача коммивояжёра (коммивояжёр бродячий торговец) является одной из самых известных задач комбинаторной оптимизации. Задача заключается в отыскании самого выгодного маршрута, проходящего через указанные города хотя бы по одному разу с… … Википедия

Задача коммивояжёра — Оптимальный маршрут коммивояжёра через 15 крупнейших городов Германии. Указанный маршрут является самым коротким из всех возможных 43 589 145 600. Задача коммивояжёра (англ. Travelling salesman problem, TSP) (коммивояжёр … Википедия

Задача о ранце — Пример задачи о ранце: необходимо разместить ящики в рюкзак при условии на вместимость рюкзака 15 кг, так чтобы суммарная полезность предметов в рюкзаке была максимальной. Задача о ранце (рюкзаке) (англ. … Википедия

Задача о максимальном потоке — Максимальный поток в транспортной сети. Числа обозначают потоки и пропускные способности. В теории оптимизации и теории графов, задача о максимальном потоке заключается в нахождении такого потока по транспортной сети, что сум … Википедия

veter.academic.ru